El festival Sónar +D 2024 ha puesto al ser humano en el centro. Este año, los algoritmos y la inteligencia artificial (IA) están muy presentes, pero con una declaración de intenciones: por muy sofisticados que sean, el individuo es el protagonista.

Ya sea para dar indicaciones y moldear el comportamiento en tiempo real, para extraer componentes a nivel físico y materializarlos, o para ser juzgados por nuestro aspecto, el ser humano tiene un papel activo en este Sónar, al ser nosotros quienes llevamos las riendas y, en todo momento, damos las instrucciones.

Dónde incide la IA

Los algoritmos están hoy en todas partes, incluso en el cine o la publicidad. Desde el aspecto más estético hasta el más profundo y reflexivo, pasando por la creatividad pura y dura de la imagen y el sonido. Y cada vez se desdibuja más la línea de lo que es una cosa y la que es otra. ¿Pero cómo puede ser esto?

Detalle de una obra generada por IA en la instalación The Generative Art Museum

La instrumentalización de la voz es uno de los ejemplos. Dicho de otra manera, convertir la voz en un instrumento de música como pueda ser un piano o una guitarra. Un algoritmo desarrollado por Barcelona Supercomputing Center (BSC) tomaba los datos de nuestra voz, a partir de los fonemas que detectaba: este era el input. A partir de ahí, la IA observa cómo es el comportamiento del sistema fonador y respiratorio, pero además, esos mismos fonemas se representaban en una interfaz que recuerda a un piano. Es música, pero es logopedia y también matemática y anatomía. Y todo con un pilar: la máquina que los une.

El control del ser humano

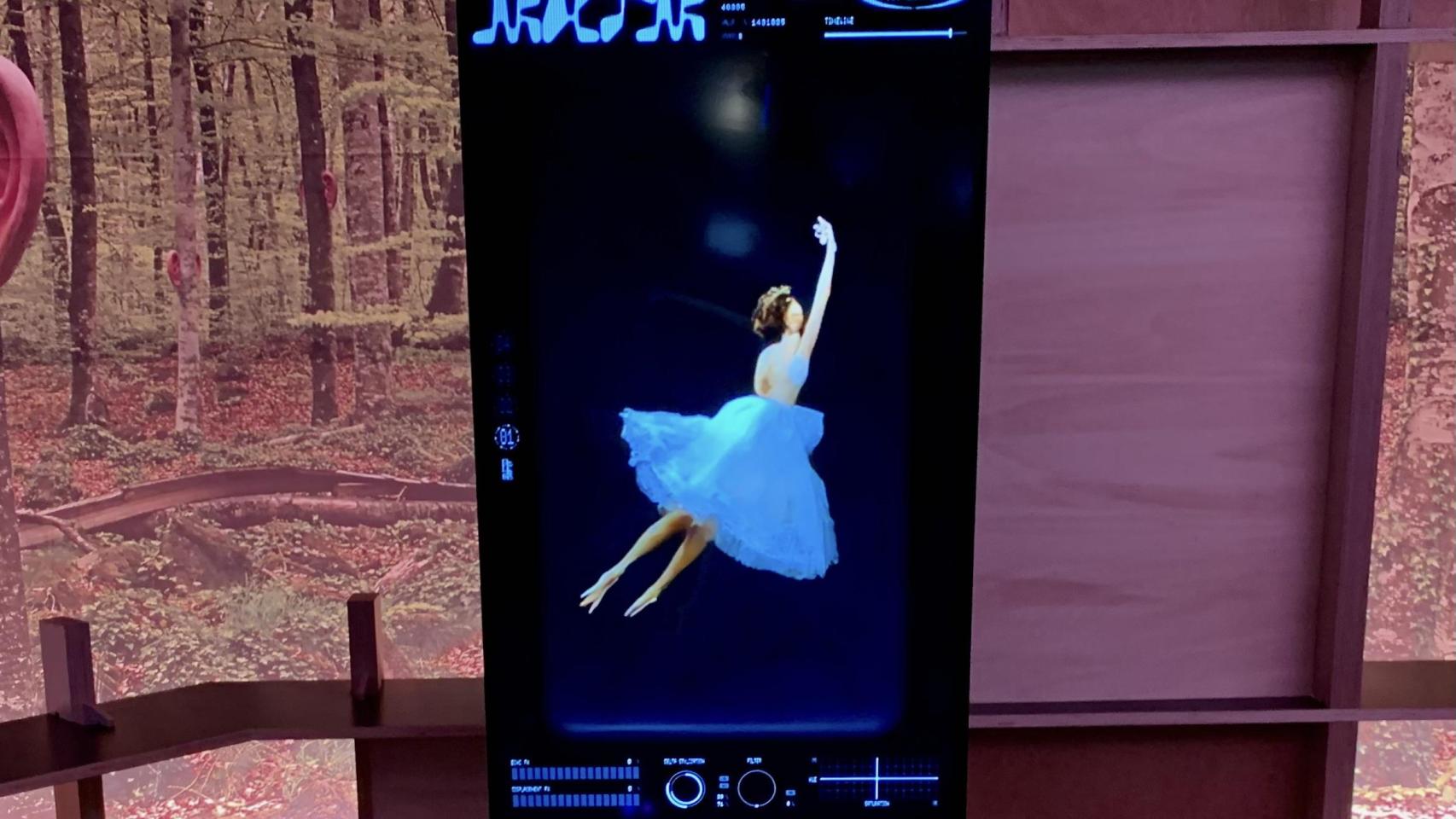

Para manejar las inteligencias artificiales es necesaria una persona. Algo que se da en la creación de piezas musicales a través de sonidos que dibujan figuras, o la posibilidad de decirle a un algoritmo cómo queremos que se comporte, mientras se está reproduciendo un vídeo en tiempo real y se le dan indicaciones de cómo ha de cambiar este vídeo.

Fotograma de la instalación de vídeo Momentum

Incluso en la publicidad, a partir de la creación de anuncios personalizados. O también, en las identidades virtuales, en las que se genera un modelo 3D de un personaje con estilo cyberpunk, y gracias a un algoritmo que detecta los movimientos de una cámara, se mueve mimetizando los movimientos que el ser humano lleva a cabo.

La instalación 321Rule: T.R.A.C.T Explorer

También algo tan específico como los materiales raros usados en la industria y la creación de políticas ambientales toma partes de la IA y de la persona. Una de las instalaciones consiste en poder seleccionar una cantidad de diferentes materiales que se muestran en pantalla, representados como cubos. Y en función de la cantidad que se selecciona, se crean diferentes tipos de patrones.

La IA que te juzga

Otra de las joyas de la corona es un algoritmo que, literalmente, te juzga por tu aspecto. Algo que resulta controvertido. Pero, precisamente, la intención era esta: ¿puede una máquina juzgar al ser humano por cómo viste, o por su expresión facial? Sí.

La mecánica es sencilla: hay que sentarse delante de una cámara, y en una pantalla aparecerán las frases que la máquina va a decir en base a lo que ve. Habla de la personalidad y de la forma de ser. No se trata de un horóscopo, pues tiene algoritmos entrenados en las emociones y en el reconocimiento facial. Así pues, detecta si estamos felices, tristes o enfadados. El género y la procedencia étnica. Pero no es lo más duro.

La instalación de la IA The Confessional AI Ego

Cuando la IA acaba de decir qué piensa de nosotros (con previo nombre asignado, ya que no sabe nada de quién se sienta delante), esta dice si le hemos gustado o no. Los creadores han explicado a este medio que "si le gustas a la máquina, esta mostrará una foto de cómo te ve en diferentes escenarios, en las pantallas que están fuera". En caso de que a la IA no le guste lo que ve, además de que "te lo va a decir sin tapujos", "no mostrará tu foto", han añadido.